[Kinh tế Nhật báo] Việc vận hành các mô hình AI với hàng nghìn tỷ tham số đòi hỏi hạ tầng GPU lớn và bộ nhớ khổng lồ, tạo ra rào cản cho doanh nghiệp. Do đó, chi phí vận hành mô hình ngôn ngữ lớn (LLM) trở thành thách thức mới trong ngành AI. Các công ty AI toàn cầu đang đẩy mạnh phát triển công nghệ giảm nhẹ và tối ưu hóa để duy trì hiệu suất mà vẫn giảm chi phí. Các công ty trong nước cũng đang tham gia vào cuộc đua này.

Ngày 5 tháng 3, công ty chuyên về giảm nhẹ và tối ưu hóa AI, Nota, thông báo đã phát triển công nghệ lượng tử hóa thế hệ mới cho mô hình ngôn ngữ lớn 'Solar' của Upstage. Công nghệ này giúp giảm đáng kể kích thước mô hình, giảm chi phí suy luận và tăng tốc độ xử lý mà vẫn duy trì độ chính xác cao.

Dự án này là một phần của 'Dự án nền tảng AI độc lập' do Bộ Khoa học và Công nghệ Thông tin Hàn Quốc thúc đẩy. Nota đã áp dụng công nghệ giảm nhẹ và tối ưu hóa của mình vào mô hình 'Solar Open 100B' của Upstage, cải thiện đáng kể hiệu suất bộ nhớ mà vẫn duy trì hiệu suất.

Công nghệ này tập trung giải quyết thách thức kỹ thuật của mô hình 'MoE' (cấu trúc chuyên gia hỗn hợp), đang được các công ty lớn như Google và Meta áp dụng. MoE cho phép chỉ một số mô hình chuyên gia hoạt động tùy theo đầu vào, tăng hiệu quả tính toán. Tuy nhiên, cấu trúc này dễ bị suy giảm hiệu suất khi áp dụng phương pháp lượng tử hóa truyền thống.

Nota đã phát triển thuật toán 'Nota MoE lượng tử hóa' để giải quyết vấn đề này. Thay vì nén toàn bộ mô hình, công nghệ này áp dụng độ chính xác khác nhau tùy theo tầm quan trọng của các phép tính, giảm thiểu suy giảm hiệu suất trong quá trình lượng tử hóa.

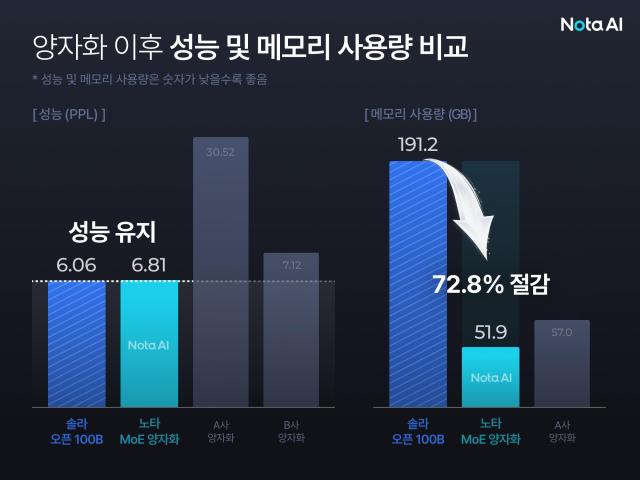

Theo Nota, khi áp dụng công nghệ này vào mô hình Solar với 100 tỷ tham số, mức sử dụng bộ nhớ giảm từ khoảng 191,2GB xuống còn 51,9GB, giảm 72,8%. Chỉ số hiệu suất PPL đạt 6,81, không khác biệt nhiều so với 6,06 của mô hình gốc, cho thấy hiệu quả bộ nhớ và độ chính xác được duy trì.

Công nghệ giảm nhẹ này dự kiến sẽ là nền tảng quan trọng cho sự phát triển của AI trên thiết bị và AI vật lý. Trước đây, các mô hình LLM lớn yêu cầu tài nguyên GPU lớn, chỉ có thể vận hành tại trung tâm dữ liệu. Tuy nhiên, khi mô hình được giảm nhẹ, khả năng triển khai AI hiệu suất cao trên các môi trường biên như robot, xe tự hành, và thiết bị thông minh sẽ tăng lên.

Theo báo cáo 'AI Index Report' của Viện nghiên cứu AI lấy con người làm trung tâm của Đại học Stanford, chi phí suy luận và hiệu quả tính toán đang trở thành chỉ số cạnh tranh chính trong ngành AI. Báo cáo phân tích rằng khi quy mô mô hình lớn nhanh chóng, chi phí hạ tầng GPU và điện năng tăng cao, các công ty AI toàn cầu đang đầu tư vào công nghệ nén, lượng tử hóa và tối ưu hóa suy luận.

Cuộc cạnh tranh LLM dự kiến sẽ mở rộng từ cạnh tranh hiệu suất mô hình sang cạnh tranh hiệu quả. Trong bối cảnh nghiên cứu về giảm nhẹ mô hình và AI biên đang diễn ra sôi nổi tại Mỹ và Trung Quốc, việc phát triển mô hình nền tảng và công nghệ tối ưu hóa cũng trở thành nhiệm vụ quan trọng tại Hàn Quốc.

Ông Chae Myung-soo, đại diện của Nota, cho biết: "Thành tựu này có ý nghĩa lớn khi áp dụng phương pháp lượng tử hóa của Nota vào mô hình AI nền tảng Hàn Quốc Solar 100B, giảm đáng kể bộ nhớ mà vẫn duy trì hiệu suất. Khi nhu cầu triển khai mô hình lớn trên thiết bị tăng, công nghệ giảm nhẹ và tối ưu hóa của Nota sẽ đóng vai trò then chốt trong việc thực hiện AI hiệu suất cao."

* Bài viết này được dịch tự động bằng AI.

© Bản quyền thuộc về Thời báo Kinh tế AJU & www.ajunews.com: Việc sử dụng các nội dung đăng tải trên vietnam. kyungjeilbo.com phải có sự đồng ý bằng văn bản của Aju News Corporation.